算力下沉时代的"云-边-端"协奏曲:数字孪生建模服务器与可视化工作站的协同进化论

时间:2026-03-01 00:44:12

来源:UltraLAB图形工作站方案网站

人气:64

作者:管理员

当10万级传感器遇见毫秒级渲染延迟,分布式数字孪生架构中"重计算"与"强显示"的硬件解耦之道

在上海临港的数字孪生变电站现场,一场静默的算力革命正在发生。控制室内,工程师们面对的不是传统监控大屏上的二维曲线,而是一面16K分辨率的LED弧形墙——上面实时流动着变压器油中溶解气体的扩散轨迹、断路器触头的电弧等离子体形态,以及整个变电站热红外场的三维重建。

支撑这一视觉奇观的后台,是一个精密的"算力分工体系": 深埋在地下机房的建模服务器正以每秒数千次的频率求解着多物理场耦合方程,而操作台前的可视化工作站则将这些抽象数据转化为光子级的逼真影像。两者通过100GbE光纤低延迟互联,构成了数字孪生系统的"最强大脑"与"最锐双眼"。

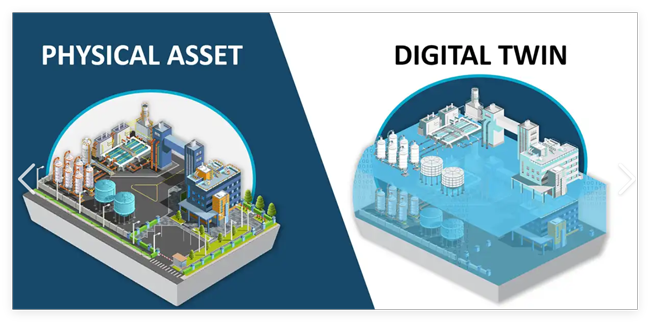

这不是简单的"服务器+电脑"组合,而是边缘计算时代数字孪生架构的范式转移——将重载建模与实时渲染解耦,让专业算力各司其职。

第一章:数字孪生的"脑-眼分离"——为什么需要分层架构?

传统数字孪生系统常采用"单体重构"模式:一台超级工作站既跑CFD计算又做8K渲染。这种模式在实验室验证阶段尚可应付,但当面对真实工业场景时迅速崩溃:

算力需求的时空错配:在智慧工厂场景中,数字孪生需要同时处理:

-

毫秒级物理计算:设备故障预测(基于有限元应力求解)、工艺参数优化(基于代理模型的实时推演)

-

帧级视觉呈现:60fps的VR巡检、8K视频墙的可视化、AR眼镜的叠加渲染

若强行在同一台机器上运行,要么是求解器抢占GPU导致画面卡顿,要么是渲染任务阻塞计算线程导致预测延迟。更严重的是,工业现场对实时性的苛刻要求(如数字孪生机床的碰撞检测需<10ms响应)使得"本地计算+云端渲染"的纯云架构因网络抖动而不可接受。

边缘计算的崛起:Gartner预测的"数据引力"效应正在显现——到2025年,75%的数据将在边缘产生和处理。数字孪生必须下沉到离物理设备最近的地方(工厂车间、变电站现场、港口码头),但又需要中心化的算力进行复杂建模。这就催生了"建模服务器(计算层)+ 可视化工作站(交互层)"的分布式架构:

-

建模服务器:驻留在边缘机房,配备多路CPU+计算卡,专注重负载的实时仿真、AI推理、数据同化

-

可视化工作站:部署在操作现场,配备顶级图形卡,专注超高分渲染、人机交互、沉浸式体验

-

协同协议:通过高带宽低延迟网络(100GbE/InfiniBand)或专用总线(PCIe扩展坞)实现"计算-显示"分离

第二章:建模服务器——数字孪生的"重脑力"担当

作为架构中的"算力引擎",建模服务器承担着数字孪生最繁重的脑力劳动:

核心职责

-

实时物理求解:基于有限元(FEA)、计算流体力学(CFD)或多体动力学(MBS)的降阶模型(ROM),以毫秒级频率更新设备状态

-

AI推理加速:运行设备健康管理的深度学习模型(LSTM预测剩余寿命、GAN生成故障样本)

-

数据同化:融合IoT传感器流(时序数据库InfluxDB/TDengine)与物理模型,使用卡尔曼滤波修正仿真偏差

-

场景生成:为可视化层生成几何实例、纹理流、物理粒子数据

硬件配置精髓(UltraLAB建模服务器方案)

CPU架构选择:

-

AMD EPYC 9655×2(双路96核):适合超大规模并行,如整厂级数字孪生的多设备联合仿真。12通道DDR5-5600提供恐怖内存带宽(每路307GB/s),支撑千万级网格的稀疏矩阵求解。

-

Intel Xeon w9-3495X(单路56核):适合单线程敏感的参数化建模(如CATIA实时特征重建),AVX-512指令集在流体计算中仍有优势。

GPU加速策略:

-

NVIDIA RTX A6000×4或A100×2:并非用于显示,而是作为CUDA计算引擎。在数字孪生中用于:

-

加速线性代数求解(cuSOLVER)

-

实时粒子系统(月尘、喷雾、火花)

-

神经网络前向传播(TensorRT优化)

-

-

NVLink桥接:多卡间实现高速P2P通信,避免PCIe瓶颈。

内存与存储:

-

2TB-4TB DDR5 ECC:数字孪生的"状态缓存",需驻留整厂BIM模型、历史数据窗口、AI模型权重。

-

全闪存阵列:8×7.68TB NVMe U.2 SSD组RAID 10,提供>10GB/s读写,支撑每秒数万次的传感器数据写入与查询。

网络接口:

-

双100GbE网卡:一张用于接收现场IoT数据(MQTT/MQTT over TSN),另一张专用于向可视化工作站推送渲染指令流(基于NVIDIA Rivermax或类似技术)。

-

DPU(数据处理器)如NVIDIA BlueField-3:卸载网络协议栈和安全加密,释放CPU核心给物理仿真。

第三章:可视化工作站——数字孪生的"视觉神经"

如果说建模服务器是"思考者",可视化工作站就是"表达者"。它面临的挑战不是计算密度,而是像素通量与人机交互的流畅度:

核心职责

-

超高分实时渲染:驱动16K LED墙、8K VR头显、多通道CAVE系统,保持60-120fps

-

交互响应:处理3D鼠标、数据手套、眼动追踪输入,<16ms延迟(VR防晕动症阈值)

-

视频合成:将建模服务器传来的抽象数据(点云、矢量场)与美术资产(PBR材质、光照贴图)融合渲染

-

边缘推理:轻量级AI(如手势识别、语音指令)本地处理,减轻服务器负担

硬件配置精髓(UltraLAB可视化工作站方案)

图形卡(绝对核心):

-

NVIDIA RTX 6000 Ada 48GB×2(NVLink):

-

48GB显存承载16K帧缓冲(约500MB)+ 高精度纹理(8K PBR材质)+ 光线追踪BVH结构

-

Quadro Sync II技术实现多卡帧锁定,避免多通道显示墙的画面撕裂

-

Ada架构的第三代RT Core支持硬件加速的实时光线追踪,用于数字孪生的全局光照(如工厂照明模拟)

-

-

专业卡 vs 游戏卡:必须选用RTX A系列/RTX Pro系列,仅专业卡支持:

-

Mosaic多屏拼接(将8台4K显示器虚拟为单一大桌面)

-

锁孔(Frame Lock)功能,与建模服务器的时间码同步

-

ECC显存纠错(7×24小时运行的数字孪生必备)

-

CPU与内存:

-

AMD Threadripper PRO 7995WX(96核):看似"大材小用",实则用于:

-

解压服务器传来的几何流(Draco压缩算法多线程解码)

-

运行游戏引擎(Unreal Engine 5)的主线程与渲染线程分离

-

处理物理引擎的客户端预测(如数字孪生中的碰撞检测预演)

-

-

256GB-512GB DDR5:作为显存的"二级缓存",预加载场景资产,避免运行时从服务器拉取数据的卡顿。

显示接口:

-

8×DisplayPort 2.0:支持UHBR 20速率,单线即可驱动8K@60Hz或4K@240Hz

-

SDI采集卡(Blackmagic DeckLink):接入现场真实摄像机画面,与虚拟场景实时合成(AR叠加)

低延迟优化:

-

PCIe 5.0 x16:与建模服务器通过PCIe over Fabric(如Broadcom PEX8796)或直连,实现GPU Direct RDMA,数据从服务器显存直接写入工作站显存,绕过CPU内存,延迟<10μs。

-

高频内存+低时序:DDR5-6000 CL30,确保UE5的Nanite虚拟几何体流送无卡顿。

第四章:协同工作流——"重算力"与"强显示"的无缝共舞

硬件分离只是基础,真正的挑战在于让建模服务器与可视化工作站像"左右手"一样协调:

数据流架构:

-

传感器→建模服务器:现场10万+IoT点(温度、振动、电流)通过MQTT over TSN(时间敏感网络)汇聚到建模服务器,写入时序数据库(TimescaleDB)。

-

建模服务器实时计算:每100ms执行一次:

-

数据清洗(异常值剔除)

-

物理求解(基于当前边界条件更新有限元解)

-

特征提取(提取应力集中区域、温度梯度极值点)

-

-

轻量化传输:不传输原始网格(太大),而是传输渲染指令流(如USD格式、或自定义二进制协议),仅包含:

-

变形后的顶点坐标(Delta编码压缩)

-

材质参数变化(如温度场映射到颜色)

-

粒子状态(位置、速度)

-

-

可视化工作站渲染:基于接收到的轻量数据,在本地GPU上执行:

-

光栅化/光线追踪

-

后处理(色调映射、抗锯齿)

-

UI叠加(仪表盘、报警信息)

-

反向控制流:

工程师在可视化工作站上的操作(如"虚拟调整阀门开度")需实时反馈给建模服务器:

-

通过WebSocket或gRPC双向流,延迟<50ms

-

建模服务器立即计算新的稳态,并将预测结果(如"5分钟后温度将超标")回传显示

同步机制:

-

时间同步:PTP(精确时间协议)确保服务器与工作站时钟误差<1ms,保证传感器数据与可视化画面的时间戳对齐。

-

帧同步:建模服务器的物理步长(如1ms)与工作站渲染帧率(60fps≈16.6ms/帧)通过锁相环(PLL)技术匹配,避免"物理超前画面"或"画面超前物理"的 jitter。

第五章:典型场景落地——从概念到机柜

场景一:智慧港口数字孪生(边缘计算节点)

-

建模服务器:部署在港口边缘机房(防尘防水IP55机柜),双路EPYC 9554,配备A100计算卡,实时求解起重机钢结构的应力-振动耦合模型(基于ANSYS Mechanical APDL)。

-

可视化工作站:位于中控室,RTX A6000×2驱动8×4K大屏(16K总分辨率),运行Unreal Engine展示集装箱装卸的实时应力云图。

-

协同效果:当起重机吊起超重箱时,建模服务器200ms内完成应力重算,可视化工作站立即在数字孪生中显示红色警告区域,同时给出结构疲劳寿命预测。

场景二:数字孪生变电站(实时仿真)

-

建模服务器:Intel Xeon W9-3495X,利用AVX-512加速电磁暂态仿真(EMTP),模拟短路故障时的电磁场分布。

-

可视化工作站:配备Varjo XR-3头显,运行Unity HDRP,展示变压器内部的电场线动态。

-

协同效果:运维人员佩戴VR头盔"进入"变压器内部,看到的电弧路径是建模服务器实时求解的麦克斯韦方程结果,而非预录动画。

场景三:分布式科研实验(多站点协同)

-

建模服务器:位于超算中心,运行气候模式WRF与作物模型DSSAT的耦合模拟。

-

可视化工作站:位于各农业大学实验室,通过100GbE网络远程连接。

-

协同效果:学生在工作站操作改变虚拟灌溉策略,命令发送至超算服务器,1分钟后收到未来7天作物生长的预测数据,并在本地以8K分辨率可视化。

第六章:UltraLAB"边缘-可视化"协同解决方案优势

1. 硬件级亲和性优化

-

建模服务器选用计算型GPU(A100/H100),工作站选用图形型GPU(RTX A6000),UltraLAB针对两者间的PCIe拓扑和NUMA架构进行调优,确保GPUDirect P2P带宽最大化。

-

为数字孪生常用的Omniverse/UE5引擎预装RTX驱动,开启多卡NVLink的帧同步。

2. 网络零抖动保障

-

提供基于RoCE v2(RDMA over Converged Ethernet)的无损网络方案,配合PFC(优先级流控)和ECN(显式拥塞通知),确保建模数据流与渲染指令流不互相挤占带宽。

3. 边缘可靠性设计

-

建模服务器支持双电源冗余、N+1风扇、ECC内存全链路保护,适应工业现场电网波动。

-

可视化工作站提供加固型机箱(抗电磁干扰、防尘过滤网),符合工业现场CE/FCC标准。

4. 软件生态预集成

-

预装NVIDIA IndeX(大规模科学数据可视化)、Kitware ParaView Catalyst(原位可视化),以及Unity/Unreal的工业插件包。

-

提供MQTT broker(EMQX)和时序数据库(TDengine)的调优服务,打通"传感器-建模-显示"全链路。

结语:分布式算力,统一体验

数字孪生的终极愿景是"身临其境的上帝视角"——既能微观的洞察设备内部的分子运动(建模服务器的算力),又能宏观的俯瞰整座城市的运行(可视化工作站的像素)。

在建模服务器与可视化工作站的分工协作中,我们看到的不仅是硬件的专业化,更是数字孪生架构的成熟:让计算的归计算,让显示的归显示,通过高带宽低延迟的纽带,在边缘计算现场实现云级的算力与本地的实时性。

UltraLAB"云-边-端"数字孪生硬件解决方案,为每一座智慧工厂、每一个科研现场、每一处关键基础设施,构建从数据到洞察、从洞察到决策的算力桥梁。

因为真正的数字孪生,不是单机上的孤岛,而是分布式算力的交响乐。

【UltraLAB技术团队 | 数字孪生边缘计算与可视化专家】

咨询专线:400-7056-800

微信号 xasun001